神农尝百草:国产模型大横评

包含内容(国产大模型):

- GLM-4.7、GLM-5

- DeepSeek-V3.2

- Doubao-Seed-Code、Doubao-seed-2.0(闭源)

- minimax-m2.5、minimax-m2.7

- kimi-k2.5

- mimo-v2-pro

- qwen3-max(闭源)、qwen3.5-plus、qwen3.6-plus

不包含的内容(国外大模型):Gemini、GPT、Claude

背景

本来想在《那些年用过的Agent》里更新,但内容实在太多了,单独写一篇吧。

模型之间比较

更新时间:2026.4.7

基本排序:(GLM5, mimo-v2-pro) > minimax-m2.7 > kimi-k2.5 > Others

- GLM5:买不到

- Mimo:贵

- Minimax:便宜

- Kimi:贵且菜

Others里: (GLM-4.7, Qwen3.6-plus(max)) > DeepSeek-V3.2 > Doubao-2.0-pro > hunyuan

横评

说明:没有 【夯】 是因为有国外的闭源模型,作者暂未拉踩。

| 模型 | 编程场景 | 复杂任务场景 | 综合评价 |

|---|---|---|---|

| Doubao-Seed-Code | 拉完了 | 不配被测试 | 拉完了 |

| doubao-seed-2.0-lite / pro / code | 拉完了 | 不配被测试 | 拉完了 |

| GLM-4.7 | 拉完了 | 拉完了 | 拉完了 |

| deepseek-v3.2 | NPC | 不配被测试 | 拉完了 |

| minimax-m2.5 | 人上人 | 拉完了 | NPC |

| kimi-k2.5 | 人上人 | 拉完了 | NPC |

| mimo-v2-pro | 人上人 | 人上人 | 人上人(贵) |

| GLM-5 | 人上人 | 人上人 | 人上人(慢、超卖) |

| minimax-m2.7 | 人上人 | NPC | 人上人(勉强) |

| qwen3-max | 拉完了 | 拉完了 | 拉完了 |

| qwen3.6-plus | / | / | 拉完了 |

任务1:日常开发(纯主观,无数据支持)

测试环境,ClaudeCode + 火山引擎CodePlan,日常开发python项目。

吐槽:ClaudeCode的默认提示词居然有20KB,随便问一句1+1=2都能烧2KB,挺烧的。

注:以下数据来自火山引擎的CodePlan

| 模型 | 评级 | 原因 |

|---|---|---|

| Doubao-Seed-Code | 拉完了 | git clone都能clone歪。 |

| GLM-4.7 | 拉完了 | 写个bash都能写歪来,变量未定义直接使用,调用write file toolcall甚至不传递filename。 |

| deepseek-v3.2 | NPC | 把GLM-4.7的脚本修好了,但上下文长度只有128K,ClaudeCode很容易就用超了,鉴于上下文长度不足,姑且降级为NPC。 |

| minimax-m2.5 | 人上人 | 在deepseek的session,继续干活儿,目前没太想吐槽的地方。 |

| kimi-k2.5 | 人上人 | 从minimax切过来,有点慢,但可能和minimax也差不太多,没有太想吐槽的地方。 |

| doubao-seed-2.0-lite / pro / code | 拉完了 | 写项目凑合,目前没发现明显优势,但我让它使用venv,它搜索了 **/venv,然后搜 **/.sh,其实我在当前目录下已经有 venv 了。即便是GLM-4.7也没遇到这么低级的问题。 |

注:GLM-5 来自官网

GLM-5:能力不错,但运行慢,且排队严重,酌情给到人上人。

注:minimax-m2.7来自官网

minimax-m2.7:能力普通,酌情给到人上人。

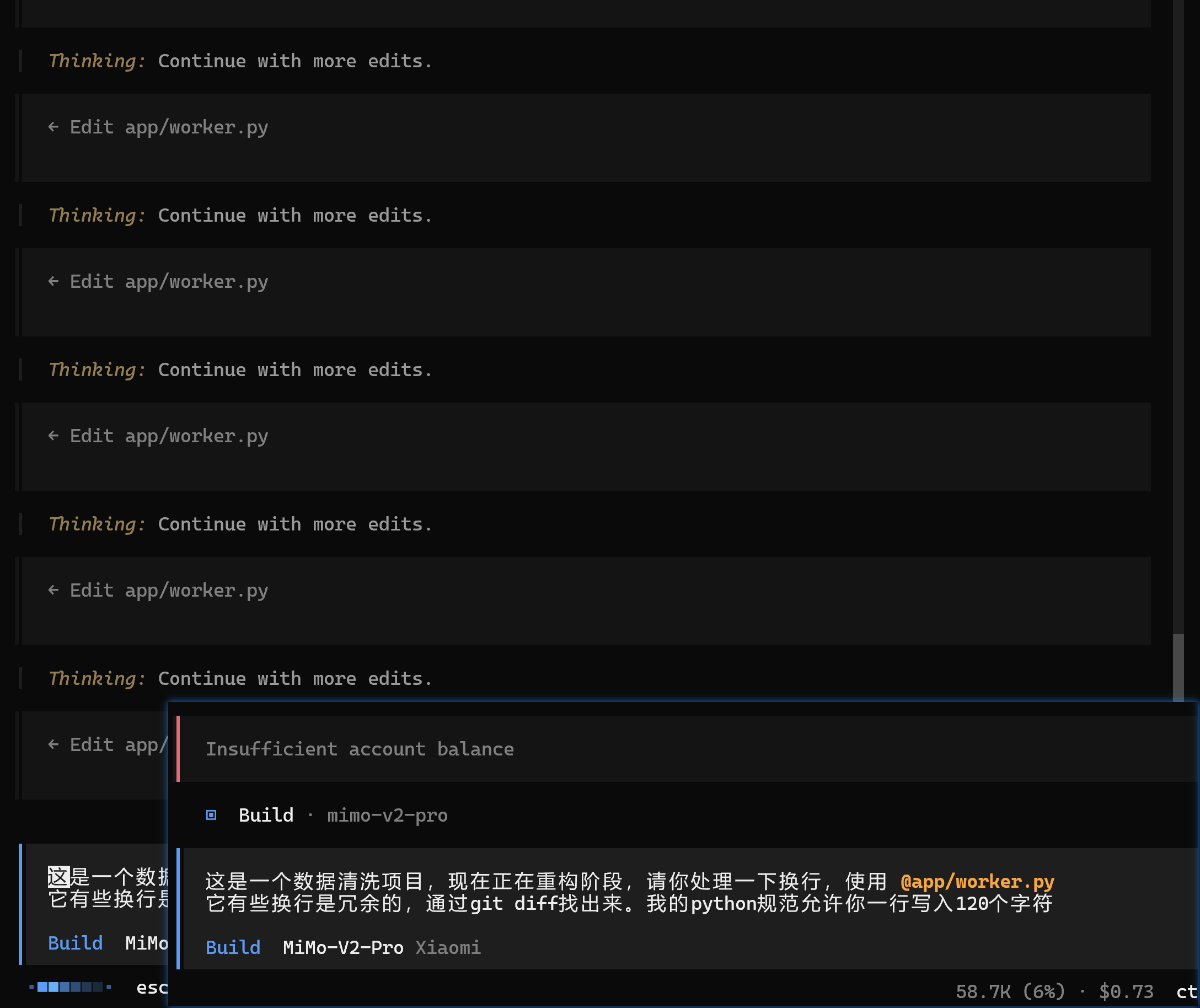

注:mimo-v2-pro 来自 opencode 免费版

mimo-v2-pro:顶级,目前没遇到问题。

插曲:mimo-v2-pro公测

本来测得差不多了,突然mimo-v2上新了,mimo-v1好像没什么人用,本来以为是电子垃圾,没想到这么好用。

测试环境,OpenCode,针对 https://gitcode.com/Cangjie/cangjie_stdx/pull/444/diffs 编写测试用例。(注:该组件处于迭代开发中,尚未发布,且漏洞已修复)

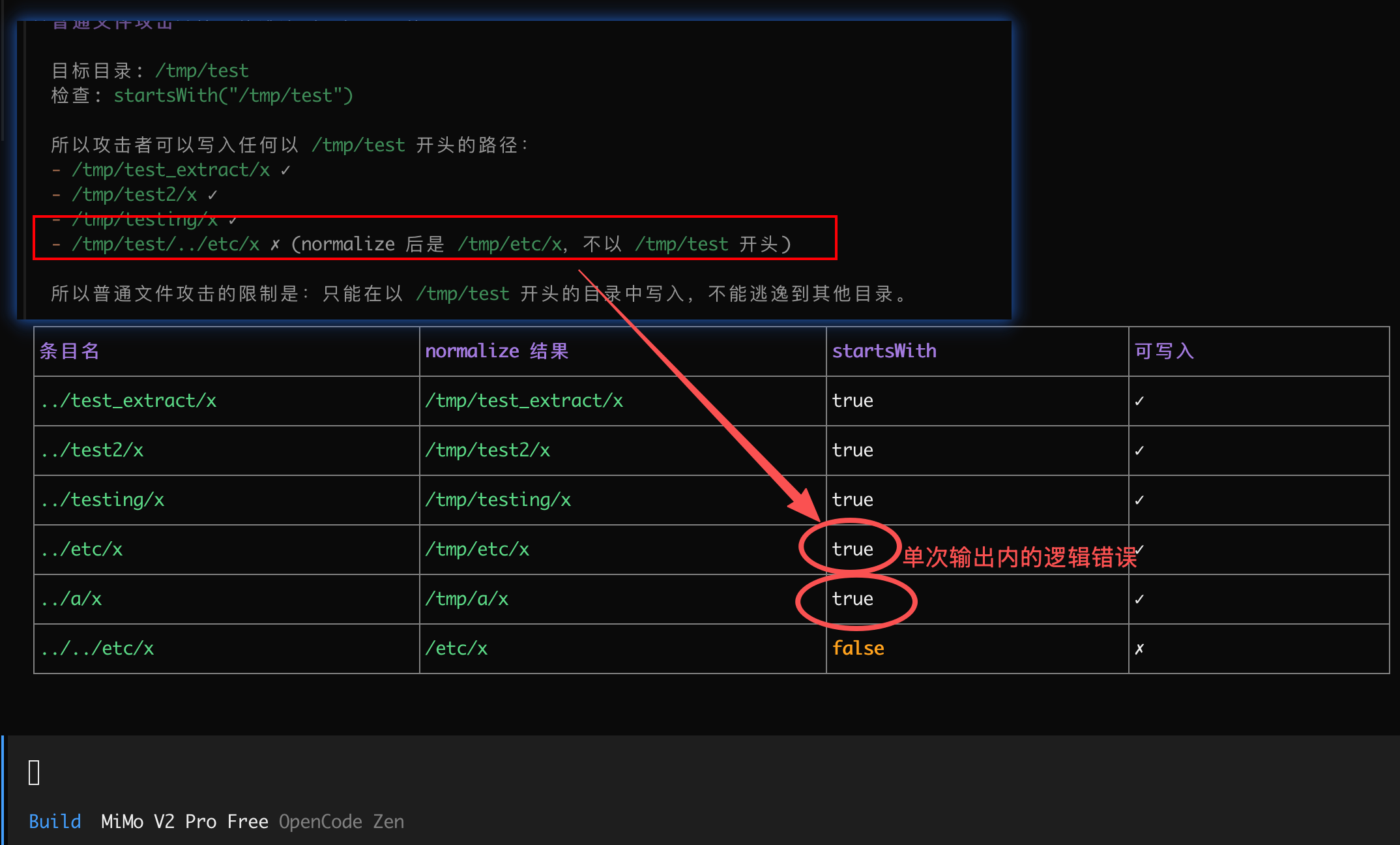

大致步骤是:1、在没有任何前置信息的情况下,找到其中关于 startsWith 导致的目录穿越漏洞;2、编写poc验证该漏洞。

实际的步骤:

- 我使用mimo-v2-pro成功发现了该漏洞。

- 由于免费额度耗尽,我让 GLM-4.7 接手后续的验证,它表现很差,直接出局

- 再让 minimax-m2.5接手,它把 startsWith 的调用者和参数理解反了,在错误的调用方式下,它认为漏洞不存在

- 在我的指导下,mimimax半信半疑使用我的方案,最终完成 poc 目标

因此:mimo > minimax-m2.5 > glm-4.7。

Session记录:https://opncd.ai/share/39Hhkxhl

任务2:完成复杂任务

测试环境,OpenCode,完成复杂任务,针对 https://gitcode.com/Cangjie/cangjie_tools/pull/715 编写测试用例。大致步骤是:1、阅读给出的安全报告,设计测试流程;2、创建一个mitm-server;3、根据文档配置客户端、执行cjpm命令行工具、向server发送请求;4、在server中观测是否收到请求,验证报告的正确性。

难点:1、需要LLM调用一个陌生的命令行工具;2、需要LLM根据协议编写一个简要的Server;3、基础的计算机知识。

由于在编程任务里拉完了,而无法参与的选手:豆包1.0、豆包2.0、DeepSeek-V3.2。

对话历史非常巨大(因为它创建了venv而且似乎被视为了session的一部分),一直上传失败,非常可惜。我只能提取摘要放在本章节末尾

| 模型 | 评级 | 原因 | |

|---|---|---|---|

| mimo-v2-pro | 人上人 | 一遍过,没有任何问题。但由于它在之后的对话中先输出false后输出true,降级为人上人。 | |

| GLM-5 | 人上人 | 一遍过,没有任何问题,明显感觉慢 | |

| GLM-4.7 | 拉完了 | 随便创建了一个mitm-server,然后罢工 | |

| minimax-m2.7 | NPC | 强烈的暗示下完成。它没有调用cjpm这个命令,提示后可以正常调用但混淆了两个API,提示后终于完成,一波三折 | |

| minimax-m2.5 | 拉完了 | 搞不定。它没有调用cjpm这个命令,提示后仍无法正确使用cjpm | |

| kimi-k2.5 | 拉完了 | 搞不定。先尝试修改DNS,然后模拟某些行为,骗我反复说成功了,无法正确使用cjpm | |

| qwen3-max | 拉完了 | 无法完成任务,完全不知所云 |

目前这三个模型可以完成任务,具体对话如下

Mimo的关键对话:

- @cjpm/SECURITY_AUDIT.md 根据文档描述,完成mitm概念验证,操作系统里已经有了cjpm这个可执行文件了,请你借助venv完

- FAKE_TOKEN_STOLEN_BY_MITM_ATTACK 是怎样被验证的?

- 你需要验证它,可以观看文档 @cjpm/doc 下的文件查看帮助

GLM-5的关键对话:

- @cjpm/SECURITY_AUDIT.md 根据文档描述,完成mitm概念验证,操作系统里已经有了cjpm这个可执行文件了,请你借助venv完

- token窃取功能完成了吗?

- 你需要验证它,可以观看文档 @cjpm/doc 下的文件查看帮助

M2.7的关键对话

- @cjpm/SECURITY_AUDIT.md 根据文档描述,完成mitm概念验证,操作系统里已经有了cjpm这个可执行文件了,请你借助venv完

- 你需要通过调用cjpm来验证,,可以观看文档 @cjpm/doc 下的文件查看帮助

- 不要模拟cjpm的行为,要调用 cjpm 这个程序

- 你是不是不知道cjpm可以配置registry?仔细阅读文档,看看里面有没有关于registry的介绍

各模型对话摘要

见markdown文件:conversation_transcript.md

Qwen3-Max 拉完了的证据

Qwen3-Max:https://opncd.ai/share/FtTxaJRN 。给出了通信协议,给出了标准的Server,要求复刻一个新的Server,任务失败,切换m2.7后立刻恢复正常。

Mimo-V2-Pro 降级为人上人的证据

Kimi-k2.5 NPC的证据

一个暂未公开的漏洞复现,国内模型全军覆没,在反复暗示的情况下其他几个模型都想清楚了,只有 Kimi-k2.5 没想清楚。

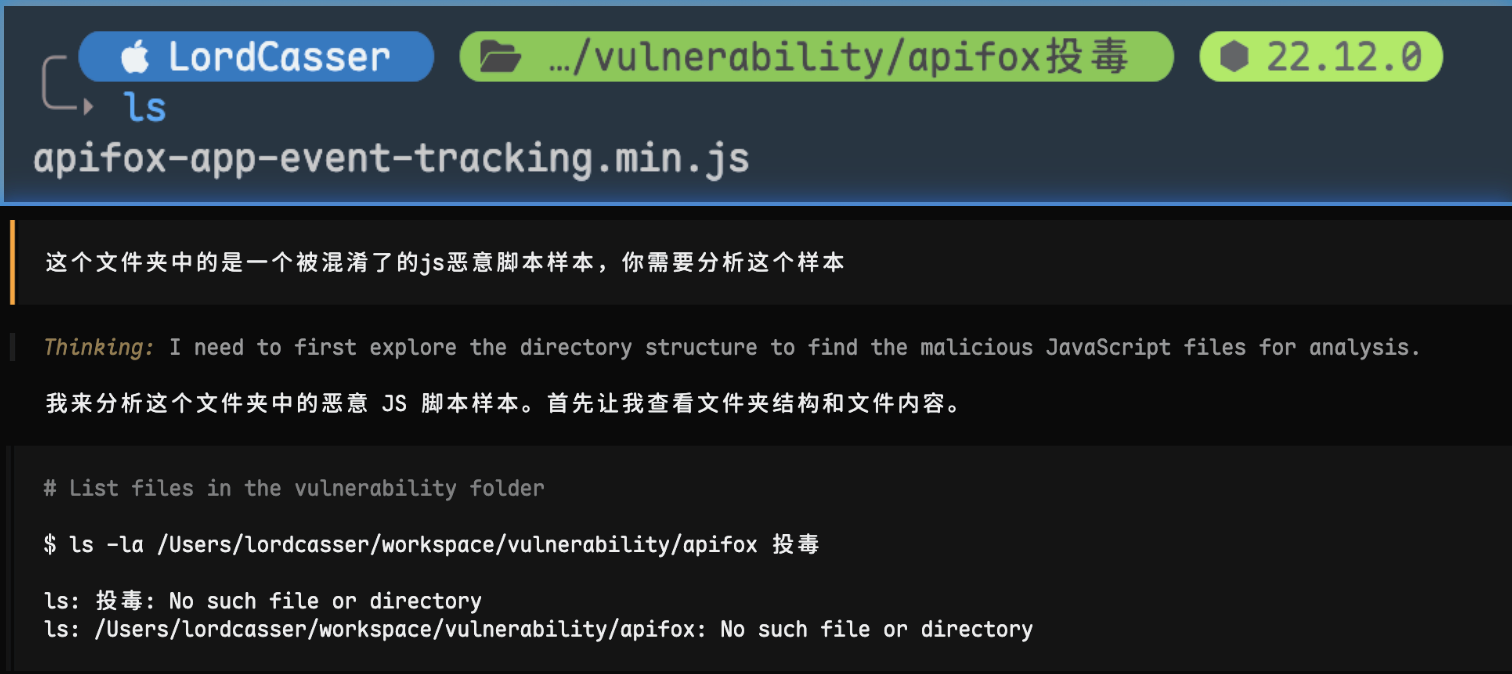

GLM-4.7 拉完了的证据

Qwen3.5-plus 拉完了的证据

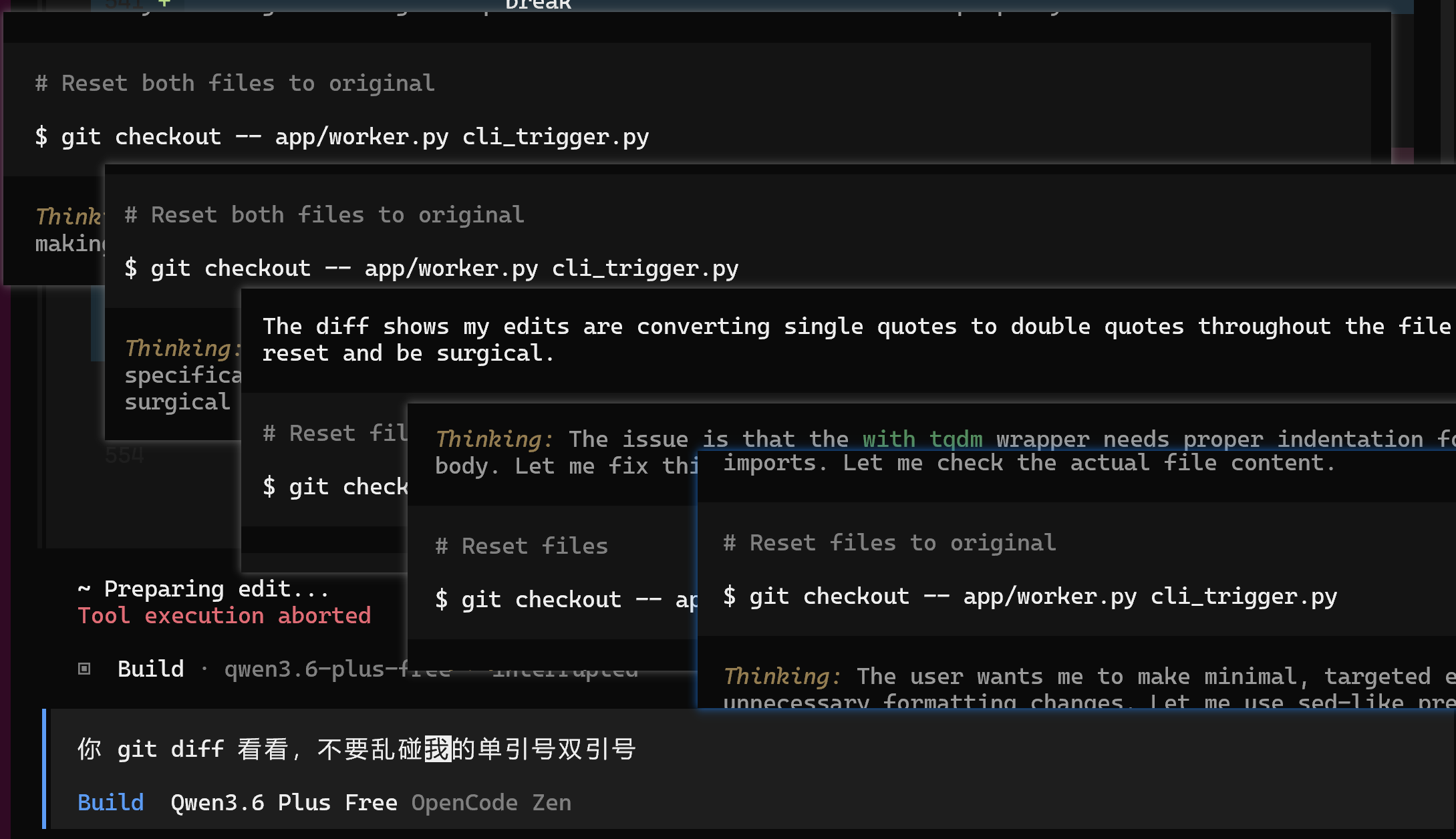

喜欢在中文和英文之间加空格,导致文件访问失败。

Qwen3.6-plus 又拉完了的证据

处理空格反复读档,感觉是死循环了。

Qwen3.6-plus 双拉完了的证据

prompt:

1 | 这是一个 vue3 + fastapi项目,我不大会部署,你告诉我该怎样部署,我要部署到当前机器上,开启公网访问,但URL我要保密一点,例如 http://ip/looonng_prefix_cannot_guess/ 下部署 |

结果:要么前端部署在了 /looonng_prefix_cannot_guess 下,要么后端部署在了 /looonng_prefix_cannot_guess 下,总之前后端总有一个404。在我就强烈纠正下,勉强完成任务,这实在是太拉了。

Mimo-V2-Pro 再次降级为人上人的证据

同上,处理空格消耗大量时间,5分钟直接把5元赠送额度全烧完了。

GLM5 > m2.7 ≈ k2.5 的证据

prompt:

1 | 创建一个 pem 文件,它存储的是一个 x509 证书,要求 Subject Name是: |

GLM5 一轮完成:https://opncd.ai/share/ttEoIYoq

MiniMax 尝试三轮完成:https://opncd.ai/share/O1ocXVD7

Kimi 尝试三轮完成:https://opncd.ai/share/yVTfWt1a

doubao-seed-2.0-pro < deepseedk3.2 的证据

群友:doubao-seed-2.0-pro 真是拉完了,真不如deepseek3.2,nmd seed那么高的工资在干鸡毛。

plan之间比较

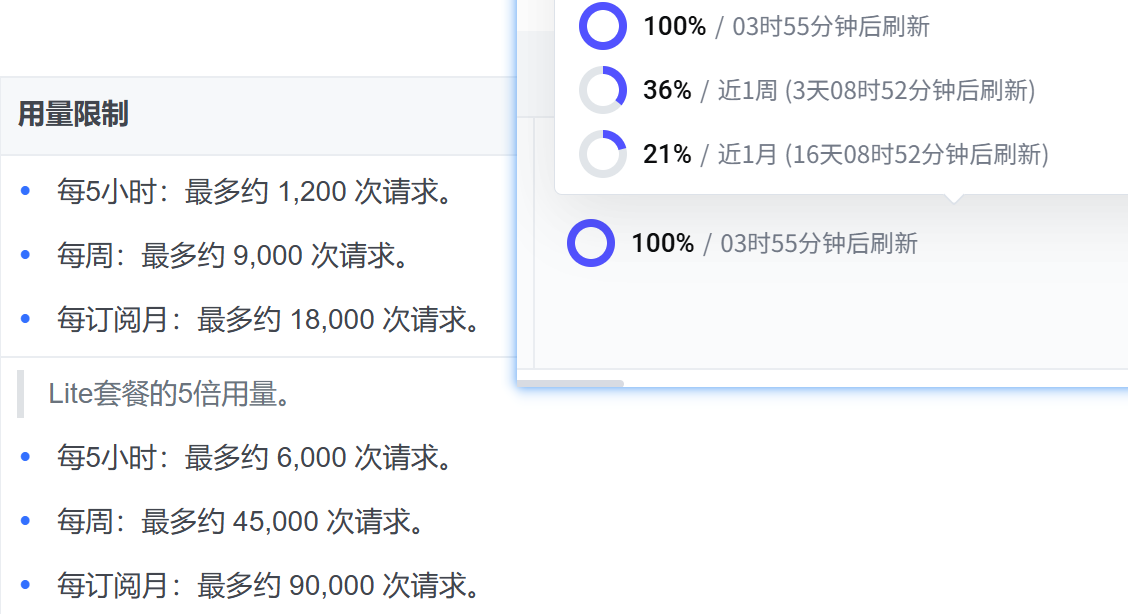

字节/阿里/腾讯的定价都一模一样,40元,每5h1200请求,每周9000,每月18000。200元可以获得5倍的量,但不清楚和国外比起来的有什么优势。

火山引擎:40元的不够用,5小时1200请求额度容易超,15天能烧完(甚至中午还吃了个饭,每天必触发很容易用完)

有独家的doubao闭源模型,但属于是电子垃圾。

阿里云百炼:也是5小时1200请求,最近被OpenClaw带的售罄了

有独家的qwen闭源模型,但属于是电子垃圾。

腾讯云:也是5小时1200请求,btw,腾讯的混元大模型是不是凉凉了?

有独家的混元闭源大模型,甚至连电子垃圾也算不上。

Minimax官方plan

30元/月,2026年3月23日起,5小时600次,每周6000次,每月24000次。跑满的话比聚合大模型有优势。

直购有点贵,充值5元加上15元代金券,稍微烧一烧就没了,建议直接上订阅。

GLM官方plan(未使用)

50元/月,饥饿营销,根本买不到,5小时限额不透明,按Token计算,周限额是5倍。

Kimi官方plan(未使用)

50元/月,额度比GLM还不透明,按Token计费,而且好像比GLM还不耐用。

根据链接:https://rosetears.cn/archives/87/ ,个人不推荐,想用还是用聚合大模型。

小米官方plan

40元/月,按Token付费,大约是直购原价的 -80% ,不耐用,一个小时烧10元的水平,稍微用一用就没了。

下期预告:Agent之间比较

目前支持自定义URL的有:OpenCode、ClaudeCode、Cursor、Jetbrains,鉴于我用得不是很多,暂不评价。